Construiré y optimizaré tus pipelines de datos

Transformando datos en ideas y convirtiendo ideas en soluciones web poderosas

Acerca de este Servicio

¿Buscas un experto en ingeniería de datos de primer nivel para transformar tus desafíos de big data en soluciones fluidas y escalables?

¡Bienvenido! Soy Nitin, un ingeniero de Big Data con más de 3 años de experiencia y profundo conocimiento en tecnologías modernas de ingeniería de datos.

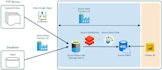

Me especializo en crear pipelines de datos robustos, confiables y eficientes usando Databricks, Apache Spark, Apache Airflow, Azure Data Factory (ADF) y arquitecturas orientadas a eventos con Kafka. Ya sea que necesites flujos de trabajo clásicos ETL/ELT, soluciones avanzadas de data warehousing o arquitecturas Lakehouse de vanguardia con Delta Lake, puedo ayudarte.

Lo que ofrezco:

- Diseño y desarrollo de pipelines ETL/ELT de alto rendimiento para entornos de datos complejos

- Soluciones de data warehousing incluyendo diseño de esquemas, modelado de datos y optimización

- Implementación de streaming de datos en tiempo real usando Kafka

- Orquestación automatizada de workflows con Apache Airflow para mayor fiabilidad y escalabilidad

- Experiencia en PySpark y SQL para transformación y análisis de datos a gran escala

- Pipelines en Azure Data Factory con workflows dinámicos y monitoreo

- Gestión de data lake y delta lake para garantizar acceso rápido, preciso y consistente a los datos.

Colaboremos para desbloquear el verdadero valor de tus datos

Mi porfolio

FAQ

Traducción automática

¿Ofrecen apoyo después del proyecto?

Sí, ofrezco soporte y resolución de problemas post-proyecto para asegurar un funcionamiento sin inconvenientes.

¿Cual es el tiempo de entrega?

El tiempo de entrega depende de la complejidad del proyecto, pero siempre me esfuerzo por entregar trabajo de calidad lo más rápido posible y mantener una comunicación clara.

¿Puedes ayudarme con la optimización del rendimiento?

¡Por supuesto! Analizo y optimizo tus flujos de trabajo de datos existentes para garantizar el máximo rendimiento y los menores costos.

¿En qué tecnologías te especializas?

Databricks, Apache Spark, Apache Airflow, Azure Data Factory, Kafka, MQTT, Delta Lake, PySpark, SQL y data warehousing moderno.

¿Qué tipo de proyectos puedes manejar?

Desde construir pipelines ETL/ELT escalables hasta gestionar datos en streaming en tiempo real y diseñar arquitecturas de data warehouse, manejo proyectos de todos los tamaños, desde startups hasta sistemas empresariales.