Construiré un scraper web en Python con selenium o beautifulsoup

Acerca de este Servicio

Traducción automática

Más de 6 años de experiencia en Python. Más de 10 pipelines de scraping entregados a clientes empresariales.

Extraeré los datos que necesitas de sitios de comercio electrónico, directorios, redes sociales, listados inmobiliarios, lo que sea y los entregaré limpios y estructurados.

Herramientas que uso:

- BeautifulSoup (rápido, para sitios estáticos)

- Selenium / Playwright (para sitios con mucho JavaScript)

- httpx / aiohttp (para scraping asíncrono de alto rendimiento)

- Proxies rotativos + manejo de user-agent cuando sea necesario

Obtienes:

- Script en Python limpio que puedes ejecutar tú mismo

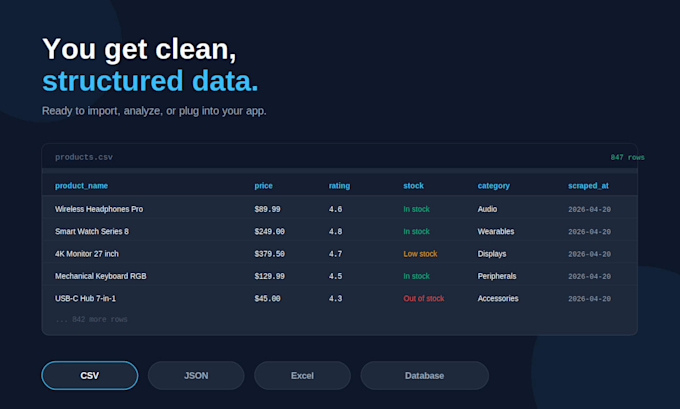

- Salida estructurada (CSV, JSON, Excel o base de datos)

- Documentación sobre cómo usarlo y modificarlo

- Scraping ético (respetando robots.txt cuando sea relevante)

Por favor, envíame un mensaje con la URL de destino antes de ordenar Necesito verificar la viabilidad (algunos sitios están muy protegidos).

Conoce a Louis J.

Full Stack Developer

- DeFrancia

- Miembro desdeabr 2026

Idiomas

Francés, Inglés

Traducción automática

FAQ

Traducción automática

¿Qué recibo al final?

Recibirás un script en Python limpio que puedes ejecutar tú mismo en tu computadora o servidor, además de los datos extraídos en el formato que prefieras (CSV, JSON, Excel o directamente en una base de datos). Incluyo una documentación clara para que puedas ejecutarlo, modificarlo o programarlo sin ayuda adicional.

¿Qué pasa si el sitio web cambia y el scraper deja de funcionar?

Los sitios web cambian con el tiempo, lo que puede romper cualquier scraper. Las correcciones menores dentro de los 14 días posteriores a la entrega son gratuitas. Para rediseños importantes o mantenimiento a largo plazo, ofrezco paquetes de mantenimiento mensual asequibles, solo envíame un mensaje para discutir.

¿Qué pasa si necesito más de 100 páginas?

No hay problema, mis paquetes incluyen hasta 100 páginas, y puedes agregar la opción de "Páginas adicionales minadas/extraídas" para scrapear tantas como necesites. También es posible proyectos a gran escala (más de 50,000 páginas), envíame un mensaje para una cotización personalizada.

¿Manejas sitios protegidos por login o sitios dinámicos con JavaScript?

Sí. Uso Selenium y Playwright para sitios con mucho JavaScript (scroll infinito, contenido dinámico, datos cargados por AJAX). Para sitios protegidos por login, puedo trabajar con tus credenciales si el scraping es para tu propia cuenta o uso autorizado, nunca para eludir controles de acceso en sitios que no posees.